|

ΕΠΙΣΤΗΜΗ ΚΑΙ ΥΓΕΙΑ

|

Καρκίνος: Σταθερά στο 7% των δαπανών υγείας – Βελτιώνεται η επιβίωση

18/3/2026, 06:16

|

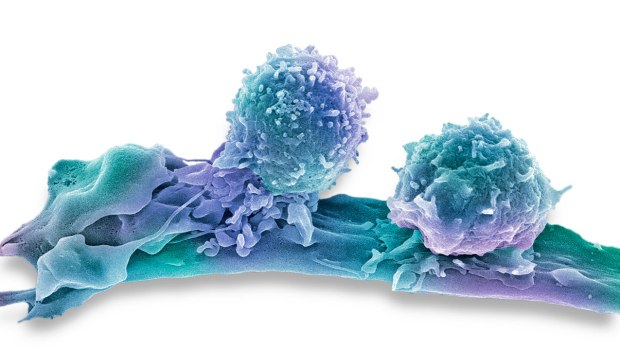

Οικονομική απειλή για τα συστήματα υγείας θεωρείται ο καρκίνος, μια από τις κυριότερες αιτίες νοσηρότητας της ευρωπαϊκής κοινωνίας. Στον καρκίνο αποδίδεται το 23% των θανάτων και το 17% των χρόνων ζωής προσαρμοσμένων στην αναπηρία που αποτελούν το άθροισμα των χρόνων που χάθηκαν από πρόωρο θάνατο και των χρόνων με αναπηρία ή κακή υγεία. Παρά το γεγονός αυτό, πρόσφατη έκθεση του Σουηδικού Ινστιτούτου Οικονομικών της Υγείας (IHE) που εκπονήθηκε για λογαριασμό του συνδέσμου ευρωπαϊκών φαρμακοβιομηχανιών EFPIA επισημαίνει την πιο καλή αντιμετώπιση του καρκίνου στην Ευρώπη, χωρίς δραματική επιβάρυνση των προϋπολογισμών υγείας συγκρίνοντας το κόστος με το όφελος από τις νεότερες θεραπείες που εφαρμόζονται. Όπως επισημαίνεται στην έκθεση, στην πραγματικότητα, παρά το υψηλό νοσολογικό φορτίο, ο καρκίνος αντιπροσωπεύει μόνο το 6-7% των δαπανών υγείας στην Ευρώπη και μάλιστα το ποσοστό αυτό παραμένει σταθερό για τρεις δεκαετίες, αφήνοντας το υπόλοιπο 93% των δαπανών υγείας για άλλες παθήσεις.googletag.cmd.push(function() { googletag.display("300x250_m1"); });googletag.cmd.push(function() {go

Διαβάστε περισσότερα |

|

|

|

Copyright 2010-2026 © pentelikonews.gr